En Internet y las redes sociales, abundan los deepfakes: vídeos, imágenes y archivos de voz manipulados y falsos que, a pesar de parecer reales, son creados mediante inteligencia artificial, utilizando videos e imágenes existentes junto con software de aprendizaje automático y algoritmos. La detección de estos deepfakes puede ser complicada, pero los expertos nos proporcionan claves para identificarlos. A continuación, exploraremos las categorías más destacadas de deepfake y también discutiremos las medidas que se están tomando en Europa y España para regular la inteligencia artificial.

PARA QUÉ SE HA CREADO LA TECNOLOGÍA DEEPFAKE

Los deepfakes se han creado principalmente por diversas razones. Muchos deepfakes se han generado con fines de entretenimiento, como la creación de parodias o contenido humorístico. La industria del cine y los videojuegos ha utilizado esta tecnología para realizar efectos especiales y animaciones faciales realistas.

La tecnología deepfake también es un campo de estudio para investigadores en inteligencia artificial, ya que ayudan a avanzar en algoritmos y técnicas de generación de contenido multimedia. Por otro lado, algunas personas han utilizado deepfakes para crear videos políticos y sátiras que critican a figuras públicas. Así mismo, se han utilizado con fines educativos, como la demostración de técnicas de IA y aprendizaje automático.

Sin embargo, los deepfakes también han generado preocupación debido a su potencial para la desinformación y el abuso, como la difusión de noticias falsas o la suplantación de identidad. Por lo tanto, su uso plantea cuestiones éticas y legales importantes.

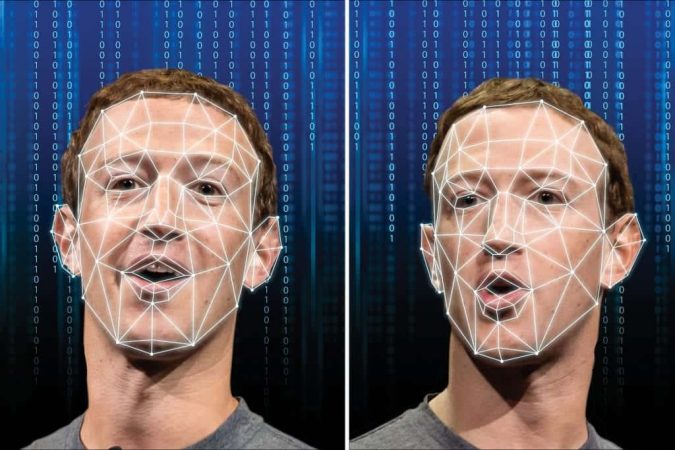

CAMBIO DE ROSTRO O FACE-SWAP

Existen tres categorías principales de deepfakes, una de ellas es la face-swap o cambio de rostro. Esta técnica consiste en reemplazar un rostro original por otro, ya sea de una persona real o ficticia, y se puede aplicar a imágenes fijas, videos o transmisiones en vivo. Aplicaciones móviles como Snapchat o Face Swap Live permiten realizar este tipo de intercambio facial. Un ejemplo destacado es la empresa Metaphysic, que ha logrado destacados ejemplos de esta tecnología, como la cuenta viral de TikTok @DeepTomCruise, su participación en el programa America’s Got Talent, donde transformaron en vivo el rostro de un concursante en el del presentador, y la resurrección en directo del cantante Elvis Presley utilizando esta tecnología.

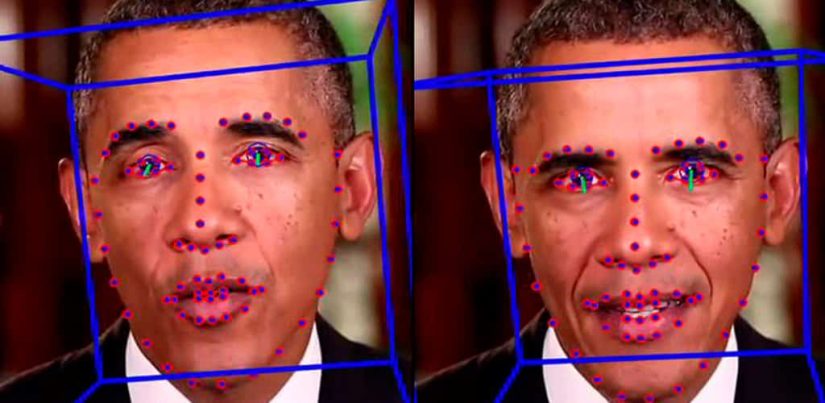

LIP-SYNC O SINCRONIZACIÓN LABIAL

En este caso, se toma un video preexistente y se cambia el contenido de audio para que parezca que la persona está diciendo algo diferente. La nueva voz se sincroniza de manera que coincida con los movimientos de labios. Un ejemplo que todos recordaremos es aquel experimento que llevó a cabo BuzzFeed, donde el presidente Barack Obama aparecía dando un mensaje de advertencia sobre los deepfakes, revelando al final que se estaba utilizando la técnica de lip-sync y que otro actor en realidad pronunciaba el mensaje.

PUPPET-MASTER O FUSIÓN DE DOS PERSONAS

Este tipo de deepfake es altamente complejo y produce resultados sorprendentes. Consiste en utilizar el cuerpo de un actor como base para crear un nuevo video, superponiendo y fusionando la imagen de otra persona. Si además se agregan efectos de audio para recuperar la voz del personaje original, se vuelve aún más difícil de detectar. Un ejemplo de esto se observa en un anuncio de Lola Flores para una marca de cervezas, donde se utilizó a una cantaora con una apariencia similar como base para el cuerpo, y luego se incorporaron más de 5,000 imágenes de archivo de la artista, junto con ajustes, efectos especiales y la voz de su hija para lograr un deepfake convincente.

CÓMO DETECTARLOS

Existen pistas que pueden ayudar a identificar un video falso, aunque los deepfakes son difíciles de descubrir, según el LISA Institute. Estos son los detalles en los que hay que fijarse:

- Fallos visuales. Muchos deepfakes presentan indicios visuales que revelan manipulación, como bordes borrosos, piel con una textura artificialmente suave, movimientos entrecortados o discrepancias en la iluminación.

- Cuello y cara. Estos videos suelen modificar solo los rostros y no el cuerpo completo, lo que puede resultar en diferencias visibles entre el cuerpo y el rostro.

- Parpadeo. En un deepfake, la persona tiende a parpadear menos que en un video real, ya que el algoritmo no puede replicar este movimiento de manera natural.

- Boca. Los algoritmos de inteligencia artificial a menudo no pueden replicar con precisión la lengua, los dientes y el interior de la boca al hablar, por lo que cualquier error en esta área indica un video manipulado.

- Sonido. En muchos casos, la voz no coincide correctamente con la imagen, lo que provoca falta de sincronización entre el movimiento de los labios y el sonido.

- Detalles. Examinar cuidadosamente la grabación, reproducirla a velocidad reducida y buscar modificaciones repentinas en la imagen o cambios en el fondo del video puede proporcionar pistas de manipulación.

- Origen. Investigar quién compartió el archivo inicialmente, en qué redes sociales y verificar el contexto original de publicación pueden ayudar a detectar un deepfake.

- Duración. La mayoría de los deepfakes son cortos, con una duración de unos pocos segundos. Un video extremadamente breve y con contenido poco convincente puede ser una señal de alerta.

¿SE PUEDEN CONTROLAR LOS DEEP FAKE?

El control de la inteligencia artificial está siendo abordado por diversos actores a nivel global. Por un lado, más de 1.000 investigadores y empresarios en el campo de la inteligencia artificial, incluyendo figuras como Steve Wozniak o Elon Musk han emitido una carta abierta para solicitar una moratoria de seis meses en el desarrollo de esta tecnología debido a preocupaciones sobre su capacidad para competir con los humanos, lo que podría resultar en la pérdida de empleos y la difusión de desinformación. Buscan un desarrollo seguro que garantice efectos positivos.

En Europa, se están dando los primeros pasos hacia la regulación de la inteligencia artificial con el desarrollo del Reglamento de Inteligencia Artificial (The AI Act), actualmente en debate en la Unión Europea. Esta ley tiene como objetivo asegurar que los sistemas de inteligencia artificial utilizados en Europa sean seguros y respeten los derechos fundamentales y valores de la Unión, proporcionando un marco legal uniforme que los Estados miembros deben incorporar a sus normativas nacionales.

AGENCIA ESPAÑOLA DE SUPERVISIÓN DE LA IA

España se ha destacado al anunciar la creación de la Agencia Española de Supervisión de la Inteligencia Artificial (AESIA), que tendrá autoridad para certificar y sancionar, garantizando el cumplimiento del futuro reglamento europeo. La AESIA se enfocará en establecer protocolos de seguridad auditables y posiblemente creará un sello de calidad que las empresas pueden obtener para demostrar que operan de manera ética y legal. Aquellos que obtengan el certificado podrán ganar la confianza de los ciudadanos, mientras que las infracciones podrían dar lugar a sanciones o la retirada del sello.

EXPERTOS DE TODOS LOS CAMPOS PARA EL CONTROL DE LA IA

Los profesionales que formarán parte de la futura AESIA deberán contar con perfiles técnicos y jurídicos especializados en nuevas tecnologías y seguridad informática. No obstante, José María Alonso enfatiza la importancia de incluir en estos equipos a expertos de diversas disciplinas, como lingüística, sociología o medicina, que puedan aportar sus perspectivas sobre posibles aplicaciones y posibles abusos de la inteligencia artificial. «No se puede basar la regulación únicamente en el conocimiento de ingenieros y abogados. Debería haber foros de discusión que integren todas estas perspectivas para un enfoque multidisciplinario inclusivo», subraya.