En los últimos meses, el discurso de Donald Trump sobre la inteligencia artificial ha dado un giro que pocos anticipaban. Hace apenas un año, su administración eliminó la orden ejecutiva de Joe Biden que establecía estándares de seguridad para la IA; hoy, ha pactado con Google DeepMind, Microsoft y xAI para evaluar sus próximos modelos antes de cualquier lanzamiento comercial. El argumentario de que regular equivale a frenar la innovación parece haber chocado con una realidad más tozuda.

La marcha del zar y el fin de la doctrina del laissez-faire

Según el análisis que ofrece DW Español, el cambio de rumbo tiene raíces profundas. Primero, la salida del inversor David Sacks, quien ejercía como zar de la inteligencia artificial y las criptomonedas, vació de influencia a la facción más anti-reguladora de la Casa Blanca. Su relevo ha recaído en el secretario del Tesoro, Scott Bessent, y en la jefa de gabinete, dos perfiles mucho más sensibles a los riesgos sistémicos de la tecnología.

Además, el canal señala que la presión pública ha ido creciendo a un ritmo que la administración ya no puede ignorar: el temor al desplazamiento laboral, la factura energética de los centros de datos, la invasión de la privacidad y el deterioro de la salud mental han convertido la IA en un asunto electoralmente incómodo. De hecho, las preocupaciones publicas se han vuelto transversales y empiezan a inquietar incluso a legisladores republicanos que antes defendían la desregulación a ultranza.

La chispa que encendió la alarma en el Tesoro y la Reserva Federal

Pero, según la corresponsal de DW en Nueva York, Ana Nieto, el detonante más inmediato fue el anuncio de Anthropic. Hace semanas, esta empresa presentó el modelo Mitos, diseñado para identificar vulnerabilidades de seguridad en software. La propia compañía lo calificó como un punto de inflexión en ciberseguridad.

La evidencia del poder de este modelo de inteligencia artificial preocupó tanto al secretario del Tesoro y al presidente de la Reserva Federal que convocaron de urgencia a la gran banca de Wall Street para testar qué significaba realmente tener una herramienta capaz de escanear sistemas críticos con ese nivel de precisión. El pánico no fue menor: si una empresa privada podía hacerlo, también podían hacerlo actores hostiles.

Llama la atención que la administración Trump, tradicionalmente alérgica a cualquier atisbo de supervisión tecnológica, haya reaccionado con tanta celeridad. La lectura que hace DW es que la seguridad nacional ha terminado imponiéndose a la retórica de la desregulación.

‘Trump ha comenzado a quedarse cada vez más aislado en este asunto, a medida que crecen las preocupaciones públicas por el impacto de la inteligencia artificial.’

— DW Español

El contexto global: de Bruselas a Pekín

El viraje de Washington no se produce en un vacío. Mientras Estados Unidos daba largas a cualquier tipo de control, la Unión Europea ya ha aprobado su propio reglamento de IA y China mantiene un férreo control sobre sus empresas tecnológicas. Lo que antes parecía una ventaja competitiva —la ausencia de ataduras— empieza a leerse como un factor de riesgo reputacional y diplomático.

En su informativo, DW recuerda que la presidenta de la Comisión Europea, Ursula von der Leyen, ha insistido en que “un trato es un trato” frente a las amenazas arancelarias de Trump, en un clima donde la tecnología se ha convertido en un arma geopolítica más. Así, la supervisión de la IA no solo responde a una demanda interna, sino también a la necesidad de no quedarse atrás en un tablero internacional cada vez más regulado.

Entre auditar la IA y el pulso judicial con Elon Musk

Mientras Washington calibra cómo y con qué intensidad supervisará los modelos más potentes, el sector sigue viviendo su propia guerra. DW recuerda que el futuro de OpenAI está en manos de un jurado, en el juicio que le ha puesto Elon Musk. El fundador de Tesla reclama 150.000 millones de dólares por daños y pide que la empresa vuelva a su origen como entidad sin ánimo de lucro.

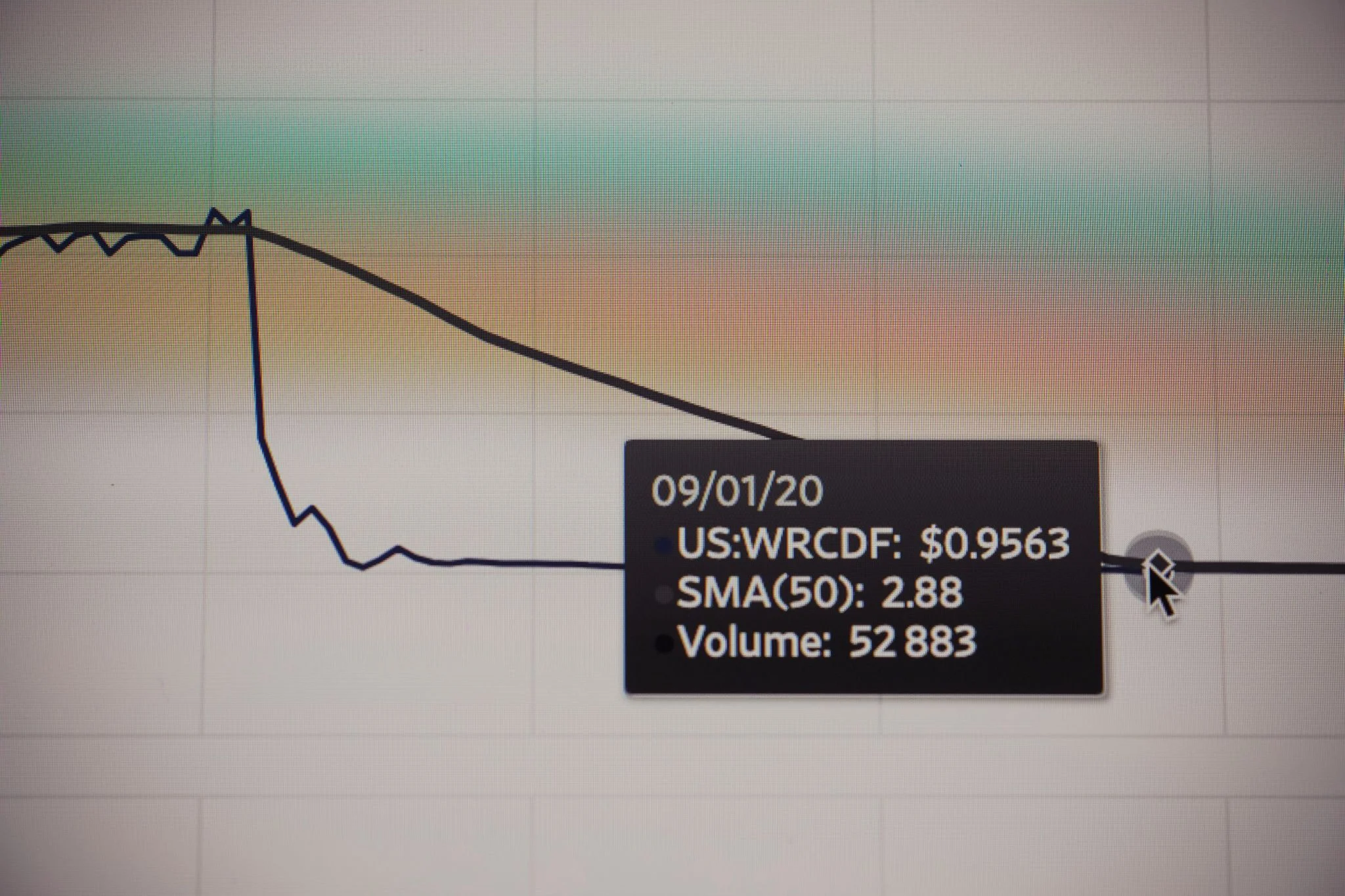

Musk, que inyectó 38 millones en la etapa fundacional, declaró la semana pasada que jamás persiguió rentabilidad y que su misión de «salvar la humanidad» fue traicionada. Sin embargo, la defensa de OpenAI ha tratado de presentar al propio Musk como un competidor directo: su compañía xAI, que se integrará con SpaceX y planea salir a bolsa, podría ser la mayor OPV de la historia.

La doble historia –la supervisión gubernamental que se abre paso en Washington y la batalla judicial que redefine los cimientos de la inteligencia artificial– deja una sensación de fin de ciclo. Los años del «todo vale» en Silicon Valley, al menos en el discurso oficial, empiezan a tener fecha de caducidad.

Implicaciones para el lector y el nuevo mapa de la regulación

Para quien mira desde fuera, este vaivén tiene consecuencias tangibles. La decisión de la Casa Blanca abre la puerta a que los grandes laboratorios de IA –muchos de ellos estadounidenses– tengan que someterse a pruebas de seguridad antes de que sus productos lleguen al mercado. Eso puede traducirse en retrasos, pero también en una tecnología más fiable y transparente. El riesgo, como apunta DW de forma implícita, es que el Gobierno utilice ese acceso para fines de defensa que escapen al control democrático.

Lo que ha ocurrido en Estados Unidos tiene además un espejo en Bruselas, donde la UE ya ha legislado, y en China, que nunca ha dejado de controlar férreamente a sus empresas de IA. La gran incógnita es si esta nueva fase de supervisión servirá para que el ciudadano recupere confianza o si, por el contrario, añadirá una capa más de opacidad.

El vídeo de DW concluye, en esencia, con una pregunta latente: ¿ha aprendido la administración Trump que ignorar los riesgos no los hace desaparecer, o simplemente está comprando tiempo mientras afina cómo usar la IA a su favor? La respuesta, por ahora, sigue en el aire.