La Comisión Europea ha aceptado posponer hasta diciembre de 2027 las sanciones a los sistemas de inteligencia artificial de ‘riesgo inaceptable’, un movimiento que traslada de facto su aplicación a 2028 y que evidencia la dificultad de regular un mercado tecnológico sin controlar la cadena de valor. La industria alemana, con Friedrich Merz al frente, ha doblegado el calendario de Bruselas para proteger a pesos pesados como Siemens o Bosch de las exigencias iniciales de la norma.

Claves de la operación

- El núcleo sancionador se aplaza hasta diciembre de 2027. La Ley de IA preveía prohibir y multar los sistemas de riesgo inaceptable a partir de este año, pero las restricciones no serán efectivas hasta 2028 tras una fuerte presión alemana.

- Alemania blinda su IA industrial. El canciller Merz ha logrado que las aplicaciones de inteligencia artificial en fábricas y sistemas críticos queden prácticamente exentas, protegiendo a sus grandes campeones empresariales.

- La UE admite su impotencia ante la competencia global. El retraso es un reconocimiento explícito de que regular sin una industria propia de IA deja a Europa en desventaja frente a Estados Unidos y China.

El acuerdo, confirmado esta misma semana y del que se ha hecho eco la prensa comunitaria, responde a una presión sostenida del Gobierno alemán. Friedrich Merz, canciller desde 2025, ha hecho de la defensa de la industria germana su bandera en la UE. Alemania temía que la exigencia inicial de la Ley de IA asfixiase a su sector manufacturero, el más avanzado del continente, que integra inteligencia artificial en cadenas de montaje, control de infraestructuras críticas y robótica avanzada. La Comisión ha cedido a regañadientes, pero con una cesión de enorme calado.

De hecho, la Comisión ha reconocido implícitamente que los sistemas de ‘alto riesgo’ tal y como se definían hace seis meses ya no se consideran peligrosos. Siemens, Bosch o la neerlandesa ASML habían advertido de los costes de cumplimiento, y Bruselas ha optado por eximir a las aplicaciones industriales. Lo que se consideraba inaceptable en enero es ahora tolerable, un volantazo que descoloca al regulador y desautoriza buena parte del trabajo de AESIA, la agencia española de supervisión de la IA que aún no ha echado a andar con plenas competencias.

La rendición de Bruselas: sin industria no hay paraíso regulatorio

La decisión supone un reconocimiento amargo para la UE. Durante años, Bruselas ha defendido el ‘efecto Bruselas’, esa capacidad de imponer estándares globales a través de la regulación porque el mercado europeo es demasiado grande para ignorarlo. Con el GDPR funcionó. Con la IA, no. El desarrollo de la inteligencia artificial depende de la disponibilidad de datos, capital y talento, y Europa carece de los dos primeros en comparación con Estados Unidos y China. Regular antes de competir ha sido, según la mayoría de los analistas coincide en que, un error de cálculo que ahora se paga en forma de retraso.

Cabe recordar que la Ley de IA fue presentada en 2021 como la gran apuesta de la presidenta de la Comisión, Ursula von der Leyen, para situar a Europa a la vanguardia de la inteligencia artificial ética. Hoy, cuatro años después, el texto queda seriamente descafeinado. Las sanciones no empezarán a correr hasta que finalice 2027, y solo entonces se sabrá si la UE tiene la musculatura técnica para auditar sistemas complejos. Este periódico ha consultado a expertos que dudan de la capacidad de las agencias nacionales, entre ellas la española AESIA, para ejecutar una supervisión efectiva en ese plazo.

Europa ha comprendido que ser el ‘policía’ digital sin tener perros propios es una estrategia condenada al fracaso.

El ‘efecto Bruselas’ tiene un techo

La diferencia entre el RGPD y la IA es esencial. El primero regula cómo se tratan los datos personales, un ámbito en el que Europa seguía siendo un mercado atractivo para las grandes tecnológicas. La IA, en cambio, requiere enormes inversiones en infraestructura y un ecosistema de innovación que no se construye con leyes. China y Estados Unidos han aprovechado la ventana abierta para adelantar posiciones, mientras Bruselas discute si un sistema de visión artificial en una fábrica debe llevar sello de ‘alto riesgo’. Este retraso es un balón de oxígeno para las empresas europeas, pero también la constatación de que la UE no puede ser el único sheriff en un mundo que no acepta sus reglas.

La reacción en los mercados ha sido cautelosa. Las grandes tecnológicas europeas no cotizan en bloque de IA, pero el alivio para el sector industrial alemán se ha reflejado en cierta estabilidad del DAX. En España, el tejido empresarial tampoco oculta su satisfacción. Las pymes tecnológicas que trabajan en soluciones de IA para la industria o la logística temían un aluvión de exigencias difíciles de satisfacer sin capacidad financiera para contratar a expertos en cumplimiento normativo. Ahora disponen de más tiempo, aunque la incertidumbre sobre el diseño definitivo de la norma no desaparece.

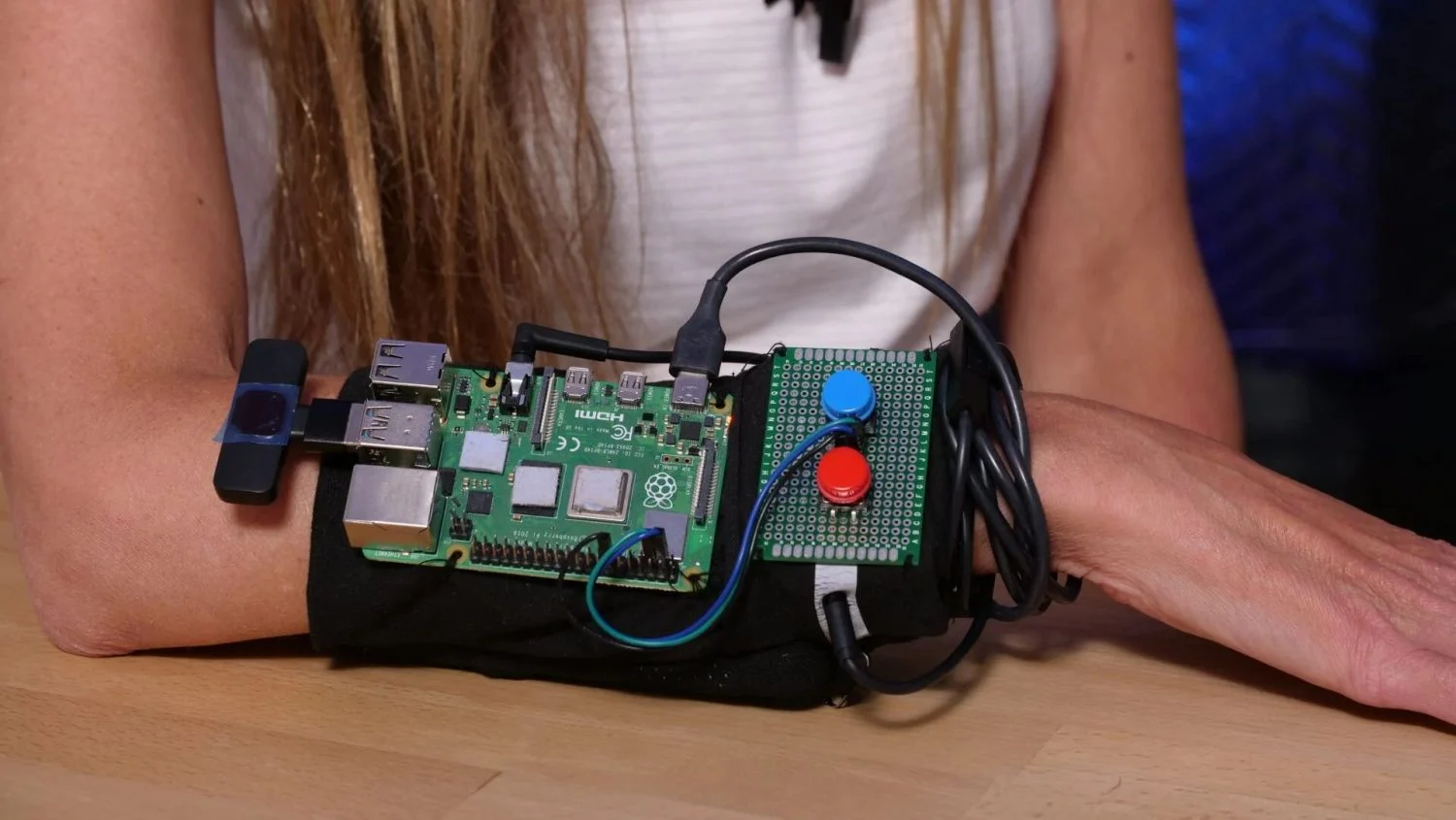

El texto refundido de la Ley sí mantiene una prohibición expresa contra los sistemas capaces de generar deepfakes de personas reconocibles , una concesión al espíritu protector de la norma que responde al escándalo de los vídeos manipulados en redes sociales como X el año pasado. También se endurece el periodo de gracia para la identificación de contenido generado por IA, que pasa de seis a tres meses. Pero el núcleo de la disputa —quién audita la IA industrial y cuándo— sigue sin resolverse realmente hasta 2028.

El precedente peligroso para la DMA y la DSA

El retraso de la Ley de IA sienta un precedente incómodo para la Comisión. Las dos grandes normas digitales en vigor, la DMA (Ley de Mercados Digitales) y la DSA (Ley de Servicios Digitales), ya están encontrando resistencia. Apple y Meta siguen sin ofrecer la interoperabilidad y transparencia exigidas, y Bruselas ha ido matizando sus requerimientos iniciales por miedo a represalias comerciales o litigios interminables. Si la presión de Alemania ha bastado para descafeinar la Ley de IA, qué impedirá que los gigantes tecnológicos estadounidenses consigan lo mismo con la DMA. La credibilidad reguladora de la UE está en juego, y este episodio no la refuerza.

Observamos un paralelismo con lo ocurrido hace más de una década con la competencia industrial en el sector de las telecomunicaciones. España, con Telefónica, supo jugar un papel relevante en la estandarización europea, pero en IA no existe un campeón nacional con ese peso. La apuesta del Gobierno de España por la AESIA como referente continental se antoja ahora más simbólica que efectiva. Sin un tejido industrial de IA comparable al alemán, la supervisión española corre el riesgo de limitarse a aplicar lo que Berlín ya ha negociado, convirtiendo a la agencia en un buzón de quejas o en un mero certificador de modelos previamente validados por gigantes extranjeros.

Aun así, el respiro temporal puede beneficiar a incubadoras y startups españolas que exploran la IA generativa aplicada a sectores como el turismo, la movilidad o el sector legal. Dispondrán de más tiempo para adaptar sus desarrollos sin el temor inmediato a sanciones desproporcionadas. La incógnita es si esa prórroga servirá para construir algo sólido o solo para alargar la agonía de un modelo regulador que nació con las mejores intenciones pero que el mundo real ha desbordado.