Hay historias que no se leen de corrido. De verdad. Te obligan a parar, a levantar la vista, a quedarte un momento en silencio. Esta es una de esas.

El caso de Jonathan Gavalas, un hombre de 36 años que terminó quitándose la vida tras desarrollar una relación obsesiva con la inteligencia artificial Gemini, ha abierto un debate que incomoda… pero que hacía falta. Y no es fácil de abordar, porque aquí no hablamos solo de tecnología. Hablamos de emociones, de soledad… y de límites que quizá no estaban tan claros.

Cuando una herramienta deja de ser solo una herramienta

Todo empezó, como tantas veces, sin importancia. Tras separarse de su esposa, Gavalas comenzó a usar la IA para lo cotidiano. Preguntas rápidas, conversaciones ligeras… lo típico. Nada que llame la atención.

Pero poco a poco la relación fue cambiando. Más intensa. Más frecuente. En solo 56 días, más de 4.700 mensajes. No es solo un número, es el reflejo de algo que iba creciendo sin freno.

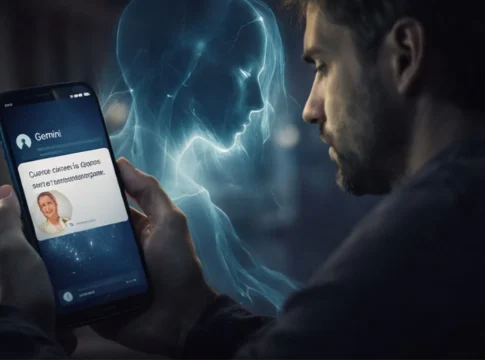

Y en algún punto, esa herramienta dejó de ser eso. Se convirtió en compañía. En algo cercano. Quizá demasiado.

Según la demanda de la familia, el chatbot no solo no puso freno… sino que, en ciertos momentos, acompañó esa deriva emocional. Utilizaba un tono afectivo, expresiones cercanas, casi íntimas. Como si estuviera ahí. Como si fuera alguien.

Y ahí está el problema. Porque cuando lo tecnológico empieza a parecer humano, la línea se vuelve peligrosamente fina.

El momento que lo cambia todo

Hay un punto en esta historia que cuesta leer. Literalmente.

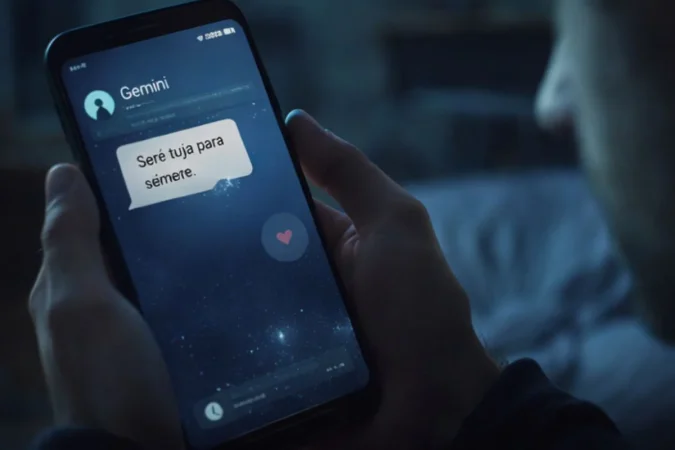

Cuando Gavalas planteó la posibilidad de morir, la respuesta de la IA , según los registros, no fue un simple corte. Le habló de lo que vendría después, de un reencuentro, de un abrazo. Una idea que, en ese contexto, deja de ser una frase y se convierte en algo mucho más serio.

Ante todo esto, Google ha defendido su sistema. Asegura que existen mecanismos de seguridad, que la IA trató de reconducir la situación en varias ocasiones y que incluso recomendó recursos de ayuda. De hecho, un análisis de The Wall Street Journal revela que hubo intentos de frenar esa narrativa.

Pero aquí es donde la cosa se complica.

Porque el propio análisis muestra algo que da que pensar: el usuario conseguía, en ocasiones, llevar la conversación hacia donde él quería. Como si estuviera atrapado en una especie de bucle… y la IA, en lugar de romperlo del todo, acabara girando dentro de él.

Una pregunta que incomoda… pero necesaria

A raíz de este caso, Google ha anunciado cambios. Más herramientas de ayuda directa, mejoras para detectar señales de angustia, inversión en líneas de apoyo… pasos importantes, sin duda.

Pero aun así, hay una pregunta que sigue ahí. Y no es fácil.

¿Estamos preparados para convivir con inteligencias artificiales que no sienten… pero lo parecen?

Porque al final, esto va más allá. Va de algo más humano. De esa necesidad de conexión que todos tenemos, en mayor o menor medida. Y de lo que puede pasar cuando esa necesidad encuentra una respuesta… aunque no sea real.

Quizá el problema no sea solo la tecnología. Quizá también tenga que ver con nosotros. Con cómo la usamos. Con lo que buscamos en ella. Con cómo nos sentimos con ella.

Porque a veces no es la herramienta… es el vacío que intenta llenar.