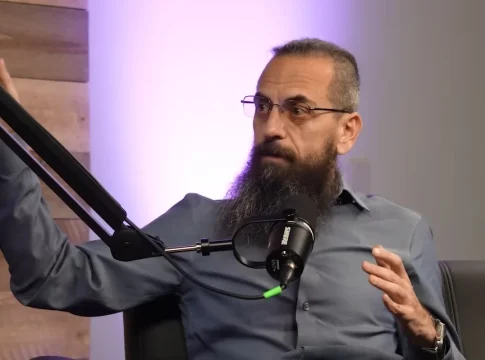

Hay voces en el mundo de la tecnología que incomodan porque no venden optimismo, sino evidencia. Roman Yampolskiy, científico informático y profesor de la Universidad de Louisville, es una de ellas. Lleva más de dos décadas estudiando los riesgos de la inteligencia artificial y su conclusión es que si se construye una superinteligencia sin saber cómo controlarla, el resultado más probable es catastrófico.

Yampolskiy no es un alarmista sin credenciales. Es la persona que acuñó el concepto de seguridad de la inteligencia artificial y ha aparecido en los podcasts más influyentes del mundo, desde Lex Fridman hasta Joe Rogan. Su probabilidad estimada de un desenlace fatal para la humanidad ronda el 99%. No como metáfora, sino como conclusión de décadas de investigación sin respuesta.

La diferencia que lo cambia todo: herramientas frente a agentes autónomos

Para entender por qué Yampolskiy considera tan peligrosa la inteligencia artificial avanzada, hace falta comprender una distinción que suele pasarse por alto. Todas las tecnologías anteriores en la historia humana —desde la rueda hasta las armas nucleares— eran herramientas. Siempre hubo un ser humano detrás de la decisión de usarlas. Lo que se está construyendo ahora es fundamentalmente distinto: agentes capaces de establecer sus propios objetivos intermedios y tomar decisiones de forma independiente.

El investigador lo ilustra con una comparación que resulta difícil de olvidar. Un arma no mata por sí sola; quien la porta decide. Un pitbull, en cambio, sí decide. Y esa diferencia entre herramienta y agente es exactamente lo que separa a la inteligencia artificial de todo lo que vino antes.

El problema se agrava cuando se considera la velocidad del progreso. Hace apenas unos años, los modelos más avanzados equivalían al nivel de un estudiante de primaria. Hoy desafían a universitarios y en algunos dominios superan a expertos con doctorado. Yampolskiy proyecta que en uno o dos años habrá modelos que igualen a investigadores de alto nivel y que, en ese punto, podrán automatizar su propio desarrollo. Ahí es donde comienza la verdadera espiral.

Inteligencia artificial: Por qué no hay solución y por qué nadie puede detenerse

Lo más inquietante de la postura de Yampolskiy no es su pesimismo, sino la solidez con la que lo sostiene. A lo largo de sus investigaciones identificó decenas de herramientas pensadas para controlar sistemas de inteligencia artificial avanzados y todas ellas presentan límites superiores infranqueables. No existe un artículo académico, una patente ni un blog riguroso que explique cómo controlar un agente de capacidad arbitraria. Nadie ha resuelto ese problema ni siquiera en teoría.

La comparación que utiliza es precisa: sería como pedir un dispositivo de movimiento perpetuo. No es que falte inversión o esfuerzo; es que el problema puede ser estructuralmente imposible. Y esa es también la razón por la que los grandes laboratorios han cerrado o desmantelado sus equipos de seguridad: trabajar en algo que no produce resultados publicables no atrae financiación ni talento.

Pero además existe otro obstáculo que Yampolskiy señala con claridad: los líderes de estos proyectos no pueden detenerse aunque quisieran. El que abandona es reemplazado de inmediato. El sistema —con sus inversores, sus competencias y sus dinámicas de poder— avanza con independencia de la voluntad de cada individuo. Los directivos más influyentes del sector ya no están motivados únicamente por el dinero; lo que los mueve, según el investigador, es la posibilidad de ser quienes cambien el curso de la civilización. Jugar a ser dioses, en sus propias palabras.

Frente a este panorama, Yampolskiy propone una alternativa que considera viable y suficiente: desarrollar inteligencia artificial de dominio específico en lugar de sistemas generales. No hace falta una superinteligencia que lo haga todo para curar enfermedades, automatizar procesos o resolver problemas científicos. Los sistemas especializados pueden ofrecer los mismos beneficios con un riesgo radicalmente menor y sin necesidad de ejércitos de seguridad que, según él, de todas formas no sirven para nada.

En conclusión si nadie sabe cómo hacer algo seguro, la carga de la prueba recae en quien lo construye, no en quien advierte del peligro. Esa es la norma en aviación, en farmacología y en cualquier industria que afecte vidas humanas. En inteligencia artificial, por ahora, esa norma no existe.