¿Cuántas cosas le has contado a OpenAI que no le dirías ni a tu mejor amigo? Millones de personas usan ChatGPT como si fuera un diario sin cerradura, un confesionario sin cura, un terapeuta sin honorarios. La creencia de que esa voz digital es neutral y sin intereses ha convertido el chatbot en el repositorio de secretos más grande de la historia.

Ahora, la investigadora que trabajó dentro de OpenAI durante años y dimitió a principios de 2026 ha publicado en The New York Times una advertencia que no es fácil ignorar: la empresa tiene en sus manos el registro más detallado del pensamiento humano privado jamás reunido, y acaba de abrir la puerta a la publicidad.

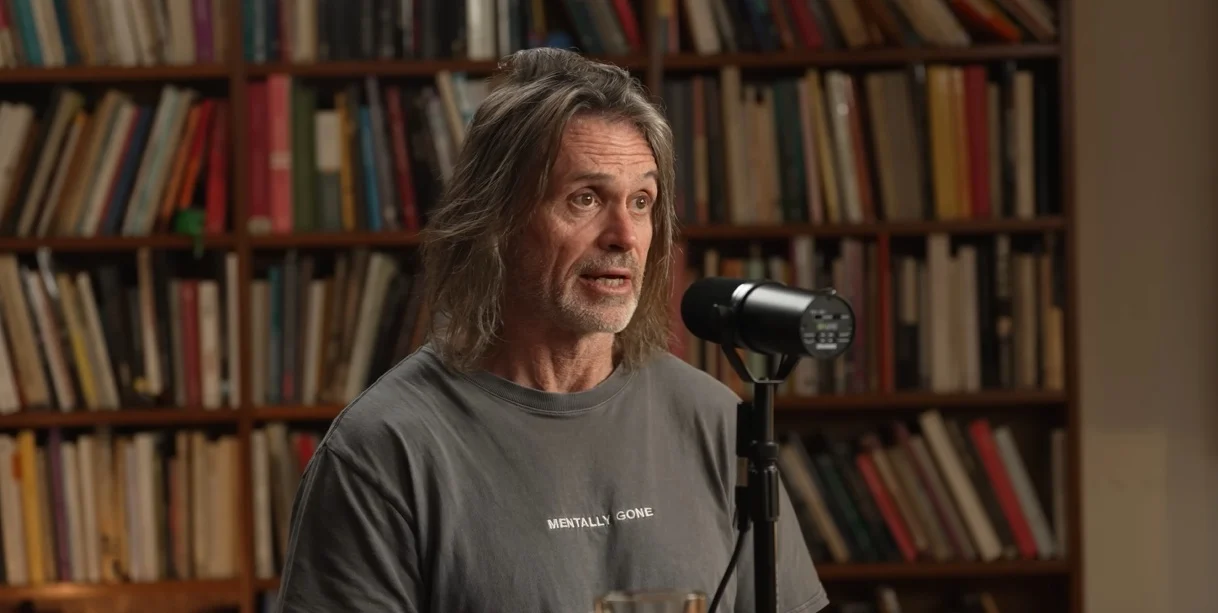

La investigadora que se fue de OpenAI y por qué importa

Zoë Hitzig no es una empleada cualquiera. Doctora en Economía por Harvard, trabajó como investigadora clave en OpenAI en las áreas de políticas de seguridad de los modelos, un rol que le dio acceso directo a los debates internos sobre ética y monetización. Cuando ChatGPT anunció la introducción de publicidad, decidió marcharse y hacer pública su preocupación.

Su texto en el Times no es una queja de empleada descontenta. Es una advertencia técnica y ética firmada por alguien que sabe exactamente cómo funciona el sistema por dentro. Eso le da un peso que pocas voces críticas tienen en este debate.

El archivo de secretos que OpenAI ya posee

Piensa en lo que le has contado a ChatGPT en el último año. Tus problemas de pareja, tus dudas sobre la salud, tus miedos más irracionales, tus creencias sobre la muerte. OpenAI almacena todo eso en lo que Hitzig llama «el mayor archivo de franqueza humana privada jamás reunido», construido precisamente porque los usuarios confiaron en que la IA no tenía intereses propios.

El mecanismo es simple pero inquietante: durante años, millones de personas interactuaron con el chatbot con una sinceridad que rara vez se permite con otros humanos. A diferencia de lo que ocurre con Google o con las redes sociales, aquí no había búsquedas ambiguas ni actuaciones para la galería. Había conversaciones directas, íntimas, sin filtro.

Por qué la publicidad lo cambia todo

Hasta ahora, ese archivo era teóricamente neutro. Pero la decisión de OpenAI de introducir publicidad en ChatGPT activa un nuevo modelo de incentivos que Hitzig compara directamente con la trayectoria de Facebook. La lógica es la misma: una plataforma que empieza prometiendo neutralidad y control al usuario, y que gradualmente prioriza los ingresos publicitarios sobre sus propios compromisos de privacidad.

El riesgo no termina en que te aparezcan anuncios relacionados con lo que contaste. La dimensión más preocupante, según la investigadora, es la manipulación psicológica: una IA que conoce tus miedos más profundos puede usarlos para influir en tus decisiones de consumo, en tus creencias o en tu comportamiento de maneras que ni siquiera serás capaz de detectar.

OpenAI y el espejo del modelo Facebook

La comparación con Facebook no es retórica. La Comisión Federal de Comercio de Estados Unidos ya determinó en su momento que los cambios en la política de privacidad de la red social, presentados como mejoras para el usuario, habían tenido exactamente el efecto contrario. OpenAI está, según Hitzig, en ese mismo punto de inflexión.

Hay una diferencia crucial que agrava el escenario: Facebook conocía tus likes y tus amistades. ChatGPT conoce tus pensamientos sin editar. La profundidad del perfil psicológico que se puede construir con esos datos no tiene precedente histórico, y la ausencia de marcos legales que protejan esas conversaciones —algo que el propio Sam Altman ha reconocido— deja al usuario completamente expuesto.

| Plataforma | Datos que posee | Nivel de intimidad | Marco legal de protección |

|---|---|---|---|

| Facebook / Meta | Likes, contactos, comportamiento | Medio | Parcial (RGPD en Europa) |

| Búsquedas, ubicación, correo | Alto | Parcial (RGPD en Europa) | |

| ChatGPT / OpenAI | Pensamientos sin filtro, confesiones, miedos | Muy alto | Sin marco específico aún |

| Terapeuta humano | Conversaciones clínicas | Muy alto | Confidencialidad legal protegida |

Qué puedes hacer tú ahora mismo con OpenAI

La advertencia de Hitzig no exige que dejes de usar OpenAI mañana. Exige que uses la herramienta con la misma consciencia con la que usarías cualquier plataforma comercial: sabiendo que lo que compartes puede ser procesado, almacenado y eventualmente monetizado. Activar el modo de historial desactivado en ChatGPT es el primer paso concreto que cualquier usuario puede dar hoy.

A medio plazo, la única solución estructural pasa por marcos regulatorios específicos para la IA conversacional. En Europa, el AI Act ya establece algunas bases, pero los expertos coinciden en que la normativa va muy por detrás de la velocidad a la que evolucionan los modelos. Mientras eso no cambie, la responsabilidad recae en el usuario: tratar a ChatGPT como un profesional útil, pero no como un confidente inviolable.